どのカメラを使えば良い?機種による違いは?レンズは?

選び方、使い方を検討するためには、仕組みを知ろう。

撮影ワークフロー記事 目次ページはこちら

次記事:02.カメラコントロール1/3

撮影のために使うカメラについて知ろう。カメラの仕組みを知るために、まずは色について知ろう。ね。そこから?そこからだ。ここへ来たからには、とりあえずカメラ買って撮影して体で覚えてみるということがすぐに出来ない事情があるか、知識を仕入れて効率よく覚えたいか、理論の大切さに気付いた、そんなところだろう。我々は200年勉強する時間などない。先人が発見した法則は短時間でありがたくインプットさせて頂き、アウトプットで自分の創造性を乗せていこう。どの道撮影スキルがある時点を超えるときに通らなければならない道だ。わりとすぐ言語化した知識が必要になることになるだろう。

カメラの仕組みを再確認しながら、レンズアクセサリー、カメラワーク、照明、録音…と続ける。目次を見て息が詰まったことだろうと思う。本出せ。

機材のスペック表を「よくわからない長文」ではなく「公式が作った仕様書」として読めるようになろう。デメリットは学習コストのみ、そしてメリットは必ず学習コストを上回る。楽しもう。

カメラの扱う光

光は電磁波の一種であり、波である。…長くなりそうだろう?

波長が長ければ電波として通信に使われたり電子レンジ(microwave)として活用されている。波長が短ければ日焼けマシンやレントゲンとして、まぁ要は生活に溶け込んでいる。波長が短いほどエネルギーが大きい。

そのうち、わずか400nm~800nmの電磁波は目で捉えることができ、「可視光」として区別されている。

この狭い範囲の電磁波によって世界を彩っているのである。

可視光と色

網膜にはRGBの3つのセンサーがある。「錐体」と云う。赤錐体、緑錐体、青錐体。

光に色そのものは付いておらず、錐体で受け取った電磁波の周波数を、脳が色として感じている。錐体の一つでも通常より刺激に鈍感であると色弱となるが、全ての人間が少なからずいずれかの錐体に強い、弱いがあると考えるのが自然であり、個人により見えている色は違うと考えられる。ただし確かめようがないな。刺激に対する反応を数値で検査ができれば”傾向は”わかるだろうが、体験することはできない。そのため突き詰めれば、プロのカラリスト(色のプロフェッショナル)が言うニュアンスと、筆者が受け取るイメージが一致しているかは確かめようがないことになる。そしておそらく違う。デバイスによっても発色が変わることと同じ考えである。幸い、編集ソフト上での同一カラーコードは異なるデバイスにおいてもデータ上は同一のものとなり、我々はこれを手がかりに色を制御する。

これを図にするとこのようなイメージとなる。

可視光の波長が長い=1秒間の振動数が少ない=周波数が低い方から赤、黄、緑、青、紫と並んでおり、赤よりも長い波長は目に見えない赤外線=IR(infrared)として、紫よりも短い波長は紫外線=UV(ultraviolet)として空間を飛び交っている。

通信で使われると言った通り、3THz以下の電磁波を電波とも呼ぶが、ラジオや携帯電話といった通信機器で使用される。このあたりをカメラ周辺機器1/3で後述する。「ワイヤレス機器と電波法」の部分だ。

※周辺機器として触れる機会も多いと思われる上、電波法そのものと2025年現在、法改正による影響というものがある以上、ぜひ読み進めて欲しいためここで触れておく。

可視光以外の電磁波も波長の長さ、つまり1秒間の振動数によって使い分けていることが分かる。内、目が色として刺激を受けることのできる範囲は、ごく僅かだ。同時に、色彩の話でよく出てくる「色相環」は、現実の色を無視したものであることも分かる。本来、赤と紫を繋げることはできないし、色相環では可視光の配色とずれ、赤が狭い範囲となる。

色の違い、色の種類を「色相」と云う。

これにより、環の反対同士となる「補色」を「反対色」と説明するのに都合が良い。今日では色と言葉が繰り返し関連付けられることで、強く結びついており、我々が色を通してメッセージを伝える際の負荷を軽減するのに役立っている。

可視光がどのような役割を持つのかある程度知っていくごとに、あなたのメッセージを伝える力は増していくとともに、逆に捉える力として撮影に大いに役立つことだろう。

https://www.amy.tokyo/color/

光の色はRGBの3色の足し算

さて、光の色を表現するためには、可視光である赤、緑、青を組み合わせれば、あらゆる色を表現できるらしい。3色を足せば足すほど白になる。足し算である。「加法混色」と云う。RGBで表現する。

絵の具などの光が反射する際に色を知覚する「物体の色と逆」だ。こちらはシアン、マゼンタ、イエローの3色であらゆる色を表現し、足すほど黒になる。RGBで育った筆者の脳内では引き算のようなイメージだ。「減法混色」と云う。これは黒をキレイに出すために、黒専用のインクを用意することが多い。合わせてCMYKで表現する。おそらく、Blueと混同しないようにKとしたのだろう。大量のコピーを必要とする印刷物では色ごとに分けて形を彫られたプレートを紙に押し付けることを繰り返していたが、黒がきれいに出ないのだ。CMYのインクを混ぜても、濃い茶色まではなるが黒にするのが技術的に難しかった。輪郭などでコントラストをしっかりと表現するために黒は別途用意して解決していた歴史があり、またこれをキーとなる色、Key Colorと呼んだことから、これの頭文字のKを取った。

そしてデジタルデータに変換する際に、データ量の関係からこの世のあらゆる色を保存すると取り回しづらくなるため、基本的には圧縮して保存する。微妙な色の違いは間引くのだ。

例えばRGBそれぞれ8bit(2の8乗)である256段階で保存するとなると、単色では下図256+256+256=768色のみを扱う。例えばR=120とR=121の中間の色、つまり小数点を含む色は繰り上げ、もしくは繰り下げになる。ただしR=0、G=0、B=0はそれぞれ完全な黒として同じ色ではある。

実際にはRGBを組み合わせて色を表現するため、R256xG256xB256=約1677万色表現できることとなる。大きな数に見えるかも知れないが、階調は失われているのだ。

微妙なグラデーションを8bitなど大きく圧縮する記録形式で保存する場合や、撮って出しなら気にならない場合も、色調補正しようとすると、コントラストを引き伸ばした部分のグラデーションが強調され、特に微妙なグラデーションになっている空などでバンディング、トーンジャンプと呼ばれる「色の変わり目の段差」が視認できるようになる。

例えばこちらの映像素材、雄々しい馬の顔を至近距離で捉えたものだが、影となっている建物や被写体のスキンに露出を合わせたため、空に白飛びが起こっている。8bitのmp4として保存されている。

これを編集ソフトのトーンカーブで、空に合わせ露出を落としてみる。

白の成分が少なくなることで青さが際立った反面、もともと間引かれ保存されていなかったグラデーションが引き伸ばされ、色の境目の段差が見えやすくなり、トーンジャンプ、またはバンディングが起こってしまった。

光の減衰はこのレベルで起きるため、完成品としてやりとりするには便利な低容量データだが、調整を前提とする映像の素材として考える場合は、納品までの編集工程で制約となり得る。

フィルムで撮影していた頃にはあまり意識しなかった悩みの誕生である。

色の深度

これを避けるためには、できるだけたくさんのデータを記録すれば良い。身近な動画データは24bitという色深度を扱う、そんなデータ量だ。bitとは、「2進数で何桁か」を表す。24bitは「2進数で24桁」ということだ。約1677万まで数えられる。これをRGBの3つの信号に分けて考える。赤、緑、青それぞれ8bit担当すれば24bitだ。256×256×256で1677万となる。多く見えるが、色の視覚情報とすると実は意外と少ない。8bitを超える色深度を扱う、データ損失の低い保存形式で、例えば10bitを扱う「Log」データや最大16bitまで扱う「Raw」データがある。10bitなら1024×1024×1024=約10億色、16bitなら65,536×65,536×65,536=約281兆色だ。

一般的なモニターが8bitにあたる。RGBそれぞれ8ビットで、スペック表では24bitと記載されているかもしれない。32bitと記載があっても、RGBの担う範囲は24bitであり残る8bitは別枠として透明度やダミーデータ用の余剰となる。そもそも再生されている映像が24bitでレンダリングされていることがほとんどであることから、普及用のモニターとしてはRGBは24bitで十分となる。RGB合わせて24を超えるbit数は圧縮した完成状態ではなく、加工する際の自由度を上げるために必要と覚えていい。

スチルの世界では早くからRaw撮影が可能だったが、データ量が多いということは転送速度が必要となる。毎秒数十枚の画像を保存する動画は、カメラや記録媒体のデータ転送速度向上に伴い、少し遅れてRaw撮影に対応した。2013年の旧Blackmagic Pocket Cinema Cameraあたりから徐々に始まったと記憶している。

1677万色を扱う色深度は扱う色数の「24bit」ではなくRGBの1つのbit数で数え、「8bit」と呼ぶことが普通である。

そしてこれをほとんどのケースで8bitのmp4として納品するのが主流だろう。カメラ側では一般的なモニタで表示できる色以上の情報を保存しておくことで、完成映像には多くの捨てられる色データが生まれてしまうのだが、色調補正時には残っている階調を呼び戻せるため、微妙な色のグラデーションを色調補正する際のバンディングを抑えることができる。撮影後の加工前提の考え方ではあるが、豊かな階調を持っているため色調補正の幅が広がることと、グリーンバックなどでのキーイング時に精度が上げられる大きなメリットが有る。

できることが少ない道具こそ上級者向け

Log、Raw撮影ができるカメラは、撮影時に設定を追い込めない場合の救済措置になり得るし、熟練者の表現の幅を広げることになる。8bitで記録する場合こそ、記録時点で色を完璧に仕上げている必要がある。そう考えると、筆者はLog、Raw撮影ができないカメラは上級者向け、できるカメラは初学者~上級者向け、とする考えをもっている。このあたりの認識は、金銭的な事情と噛み合わないジレンマがあるが、いずれの場合も、クオリティを上げるためにどこかで手間をかけていて、コストとして跳ね返っているだけである。足りない技術や問題点をお金で補う術があるかどうかだ。幸い、Log、Raw撮影では金銭、時間的コストの制約による撮影時の問題を、編集時にいくばくか取り返しの付く領域がある。撮影時、編集時、それぞれコントロールできることとできないことがあり、これを正しく知ることは撮影技術以外で映像のクオリティを上げる手段になり得る。

デジタル=ドットをイメージする

デジタルデータは0と1の組み合わせである。ここから考えると、全てがドットであるとイメージすると理解しやすいかも知れない。8×8ドットの画像より、16×16ドットの画像のほうが鮮明に見えるし、結果8×8ドットで納品するとしても元データが16×16ドットであれば加工の幅が広い。

もちろん、扱える色が多ければデータ量が増えるので、ファイル容量は大きくなる。

ここまでがカメラが考える色の話だ。表現としての色の話は分ける。

レンズから入ってくる光=「入射光」と云うが、これをそのままの像として記録するのではなく、目と同じくRGBそれぞれの光に分け、それぞれのセンサー部に届けるのが一般的だ。このイメージセンサーについて続ける。

イメージセンサー

フィルムカメラでいうフィルム。光を受け取る部品。デジタルの時代になり光を電気信号に変換するセンサー部分であり、方式が2種類ある。CCDとCMOS。我々が使う民生用デジタルカメラはほとんどCMOS。

赤い部分がセンサー。上記画像の機種は不要な反射を起こさないよう偏光するフィルターがあるため、角度によって反射光が赤く見えている。

角度による反射の見え方の違いはこう。

CCDからCMOSへ

光を電気信号に変換するイメージセンサー部だが、2025年現在デジタルカメラのほとんどはCMOSセンサーと云う方式が主流である。「スチル、ムービー用カメラではレガシー」なCCDセンサーは消費電力が大きく、処理速度が遅く、価格が高い。一方後述するグローバルシャッターと云う大きなメリットと画質は良いとされている点が優れている。その後CMOSセンサーが流通し始めると、消費電力が少なく、処理速度が早く、安価に製造できることからコストに見合った需要が見込め、開発が進み画質も向上、今日では覇権を握るまでに至った。

単板式か3板式か

このセンサー部が単板式と3板式に分かれる。

単板式

単板式はRGBの光学フィルタを1枚のセンサー(つまり単板)に並べている。拡大するとR、G、Bそれぞれの光だけを受け取るドットが並んでいるイメージだ。R部分の画はGとBでは受け取れない。本当に僅かではあるが微妙にズレた画をRGBで合わせ、境目の色を補間するなどプロセッサーで処理をするため、細かな模様やガラスの反射部分などで縞模様が発生する「モアレ」が生じる可能性を0にできない。

余談:単板式のフィルターの並び

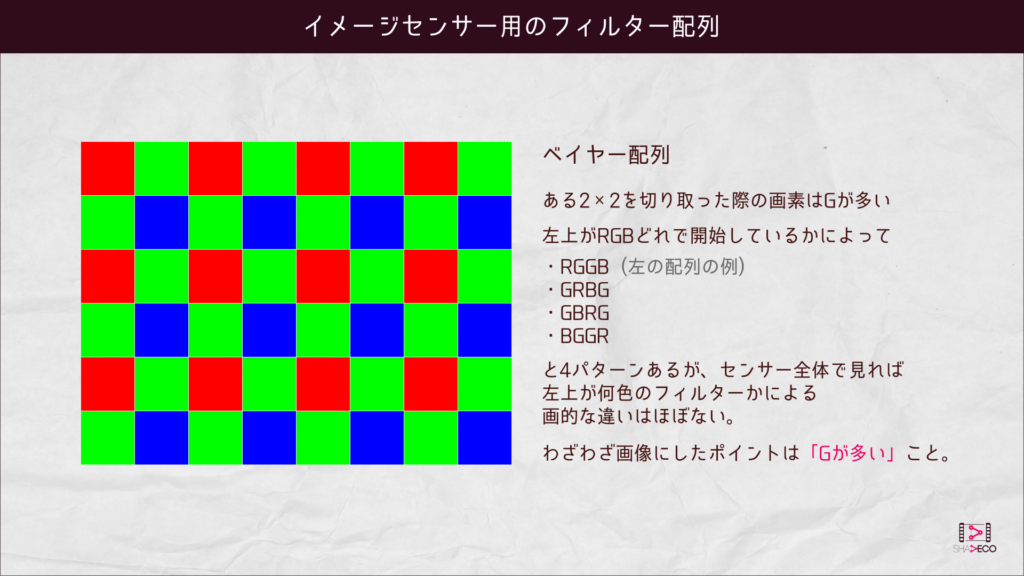

余談だが、フィルターはRGBRGB…の順に並んでおらず、「ベイヤー配列」と云う4パターンのどれかを採用している。

おや、2×2の並びの内、緑が多いね。目は555nm付近の緑の感度が高いため、これを多く配置することで一番解像度が高く感じることを利用している。

3板式

3板式は入射光をダイクロイックミラーという特定の波長を反射する鏡によって、RGBそれぞれに屈折させ単色の光を取り出すため、全面積のR、G、B画像を保存できることから同じセンサーサイズのカメラであれば感度、解像度と相対的に色再現と画質は良くなる。センサーが3つ必要となることから、スペースが必要で製造コストも高くなる。我々が撮影時に使用するような小型の一眼デジタルカメラでは単板式が多い。業務用となるシネマカメラなどは贅沢に3板式が増える。

センサーサイズ

センサーのサイズはmm数表記のほか、いくつか名前が付いている。フィルム時代のレンズを引き続き使用できるよう、フィルムカメラの規格に準じることとなった。フィルムカメラ時代を知らない我々としては馴染みがないが、古くからのユーザーに寄り添うというより、様々な説明のしやすさを優先し名前で呼ぶことが多いため、知っておくと便利だ。

フィルムにはフィルムを送る(巻き取る)ために、カメラ内部の歯車と噛み合わせるための穴(パーフォレーション)があり、ここまで含めた長さが35mmの「35mmフィルム」と云うフィルムがフィルムカメラ時代に主流だった。ドイツメーカーのライカが普及させたことから「ライカ判」とも呼ばれる。これは36mm×24mmであり、同じサイズのデジタルカメラのイメージセンサーを「フルサイズ(日本語)」「フルフレーム(世界共通)」と云う。フル?なにが?カメラを扱う上で避けて通れない用語であるため解説する。

デジタルカメラではすぐにこのサイズを開発するのが難しく、まずは一回り小さな約24mm×16mmの「APS-C」サイズのセンサーが流通し始める。元となったAPSフィルムはデジタルカメラ黎明期と普及が重なってしまったことや35mmフィルムよりも高価なことから、普及に至らず終焉を迎えている。35mmフィルム用のレンズを使いまわしても、光を取り込むセンサーのサイズが小さいということはそもそも中心部分をトリミングして使うこととなる。

レンズが取り込む光をフルで使える、つまり35mmフィルムと同じイメージセンサーを使える大きなセンサーは悲願であった。サイズ的に日本では「フルサイズ」と呼ばれ、国外ではこの35mmフィルム用のレンズが取り込む光のフルの範囲=フレームを記録できるセンサーで「フルフレーム」と呼ばれることとなった。日本ではどちらも通じるが海外ではフルフレーム一択である。

フルフレーム機の流通が続きながらも、時代とともにセンサーサイズの小型化も進み、「フォーサーズサイズ(4:3の比率の18mm×13.5)」を元にした17.3mm×13mmの「フォーサーズシステム(ややややこしい)」、これをいくつかパーツを小型化しつつ、センサー自体は同じサイズの「m4/3(マイクロフォーサーズ)」といった規格も生まれてきた。逆に大きなものでは120mmフィルムを使用する「中判カメラ」に準じた「中判」もある。さらにさらに、APS-Cに近いサイズの映画用のフィルム規格で一般的だった24mm×14mmの「スーパー35mm」など、多様なセンサーサイズのカメラが混在している。

まとめると、

| 中判 | 43.8mm×32.9mm |

| フルサイズ、フルフレーム | 36mm×24mm |

| スーパー35mm | 24mm×14mm |

| APS-C | 23.6mm×15.8mm |

| フォーサーズシステム、m4/3 | 17.3mm×13mm |

| 1/2.3型(主にスマホカメラ) | 6.2mm×4.6mm |

↓視覚的にはこのようになる。

センサーサイズによるメリット、デメリット

センサーサイズが大きいということは、被写界深度を浅くしやすい(フォーカスで後述)、記録できる明るさと暗さの範囲が増える(ダイナミックレンジで後述)。また、画素数が同じであれば1画素あたりのサイズも大きくなり、取り込める光が増える→明るくできる=ノイズを抑えられる(ISOで後述)。

対して、大きなセンサーを搭載するということは、本体が大きくなり、センサー面積以上の光が取り込めるレンズが必要で、大きなイメージを処理するCPUが必要で、消費電力も上がるなど、開発コストがかかる。

CMOSのメリットとCCDの現在

CMOSセンサーの画質面での高性能化に伴い、消費電力の少なさ、製造コストの安さから、各メーカーはCCDというセンサー方式からこぞってCMOSへ舵を切る。しかし記録できる明るさの範囲の広さや低ノイズという点では依然CCDセンサーに軍配が上がり、天文学や研究、医療現場では現在もCCDを求められることがある。我々”一般的な”コンシューマのデジカメ消費者向けにはCMOSが都合が良いということだろう。

参考:https://www.klv.co.jp/corner/difference-between-ccd-and-cmos.html

CMOSセンサーの未だ抱えるデメリット

フィルムカメラやCCDセンサーを搭載したカメラは一般的に画面全体を一度に記録するグローバルシャッターと云う方式である。CMOSセンサーが市場に出回り始めた頃から「こんにゃく現象」と呼ばれる新たな悩みが撮影者に降りかかる。

ローリングシャッターのこんにゃく現象

さて、このCMOSセンサーを装備したカメラのデメリットとしては、製造コスト、技術的な制限によって「ローリングシャッター」と云うセンサーの上のラインから下のラインに向けて順次保存する方式が多い。センサーへ届いた像は上下左右反転されているため、カメラの底から天井に向かって保存されていくわけだ。1フレーム記録するためには画面上部が先に記録され、画面下部が保存されるまで時間が進むのだ。その時間差は10~30msと1瞬ではあるが、とはいえ電車やカメラ自体を素早く動かすなど、動きが早いと被写体が斜めに歪んでしまう。

わかりやすくローリングシャッターを極端に遅く、長時間掛けて作動するものとした場合、このようなイメージとなる。※簡略化のため、現実製品ではありえない遅さであり、また、ピクセルを大きくしてある。

このように横の動きにおいては、左から右へのパン、もしくは左に高速移動した物体は7時方向(/)に歪み、逆に右から左へのパン、もしくは右に高速移動した物体は5時方向(\)に歪むことになる。

縦の動きにおいては、下から上へのティルト、もしくは上から下へ高速移動した物体は伸び、逆に上から下へのティルト、もしくは下から上へ高速移動した物体は縮むことになる。

1度に全面積を記録するためには高速なデータ転送が必要で、消費電力も上がる。熱が上がることで冷却ファンのためのスペース確保、ファン音問題やコストに大きな影響が出る。センサーが大きければなおさらだ。

ローリングシャッターの軽減方法

技術的にはCMOSセンサーでも(小さい場合?)全画面同時保存が可能らしいが、我々が手を出せるデジタルカメラはことごとくローリングシャッターであり、割り切るほかない。RED社のKOMODOシリーズがCMOSセンサーでグローバルシャッターを売りにしており、”比較的安価”なカメラであり100万円ほどだ。

Log撮影で問題なければ、Sony社のα9 IIIもフルフレーム+CMOSセンサーでグローバルシャッターである。こちらは75万円ほどであり、Raw撮影に25万円の価値を感じない場合、強力な選択肢となるだろう。

ローリングシャッターの軽減方法としては、例えばBlackmagic社のカメラのように、本体に搭載されたジャイロセンサーから得た素早いカメラ操作情報を元に補正する機能が提供されていたりする。しかし、編集ソフト上で「こんにゃく現象と逆方向に歪ませての補正」となり、左右に斜めの黒味ができてしまう。

このあたりはinaho Filmの伊納氏が機能を詳細に検証した動画をアップしてくださっている。

素早いカメラ操作は行わないか、もしくはハイスピード撮影によってセンサーから順次ラインを読み出す速度が上がるカメラもあるため、最終的にスローモーションにしないまでも、試す価値はある。しかしこの場合、フレームレート(後述)を上げることになるため、シャッタースピードが希望よりも速くなってしまうだろう。何を最優先とするショットなのかを熟考して決めたい。

素早いアクションやカメラワークが多いのなら、グローバルシャッター方式のカメラを用意するなど、大事になるだろう。とにかく予算面で不利な我々はレンタルを検討するか、これからの技術革新に期待したい。

ただし、こんにゃく現象が起きた画が人の心を動かせないかと言われたらどうだろうか。確かに気を散らせる要素には違いないが、恐れず撮影しよう。

そしてこれからの技術革新に期待だ。我々が機材に投資する限り、全てのカメラがグローバルシャッターになる日は来るだろう。

レンズ経由で光を記録するということ

光はRGBの3色の足し算であり、足すほどに白に近づく。イメージセンサーで毎フレーム光を足し算する。光を受け続けてしまっては白しか記録できない。そこで、センサー側で光に対しての感度と、光を取り込む時間をコントロールし、さらにレンズ側で光が通過する量をコントロールすることで画として暗すぎず、明るすぎない範囲で記録させる。この仕組みについて続ける。

↓次

この記事へのコメントはありません。