撮影ワークフロー記事 目次ページはこちら

前記事:02.カメラコントロール1/3

次記事:04.カメラコントロール3/3

レンズ

「絞り」に行く前に、これはレンズ内部の機構の知識となるため、事前知識としてレンズについて言及しておく。

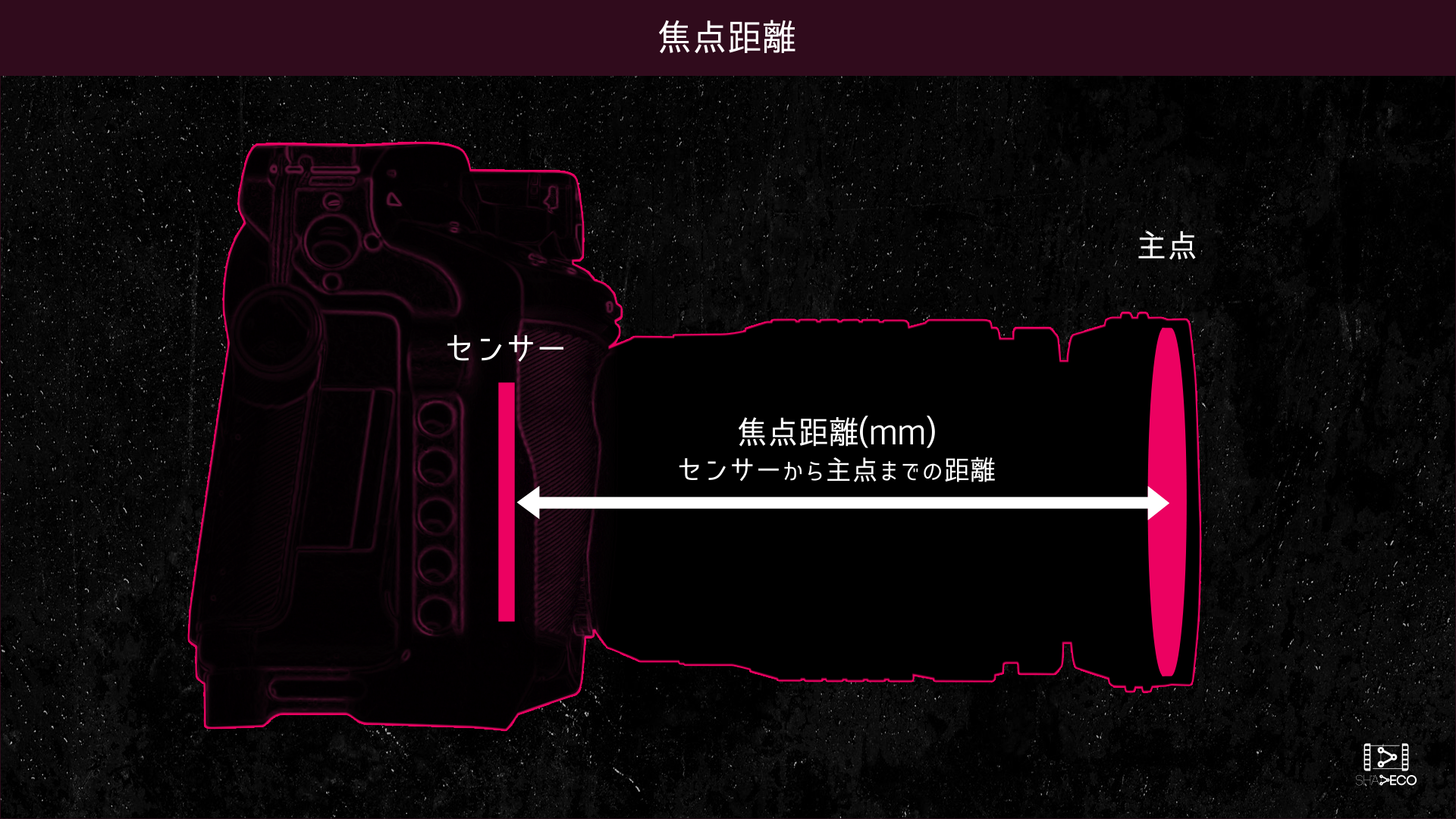

焦点距離

「主点からセンサー(結像する面、つまり焦点の合う面)までの距離」のことを「焦点距離」と云い、mm数で表記される。

主点はセンサーを挟んだ反対側の同じ距離に、同じ大きさの像ができる距離で、レンズの前後の膨らみが同じであれば、レンズの中心が主点と思って差し支えない。レンズを複数枚使う場合は主点がレンズ鏡筒の中程に食い込むこともある。レンズの全長ではないということだ。

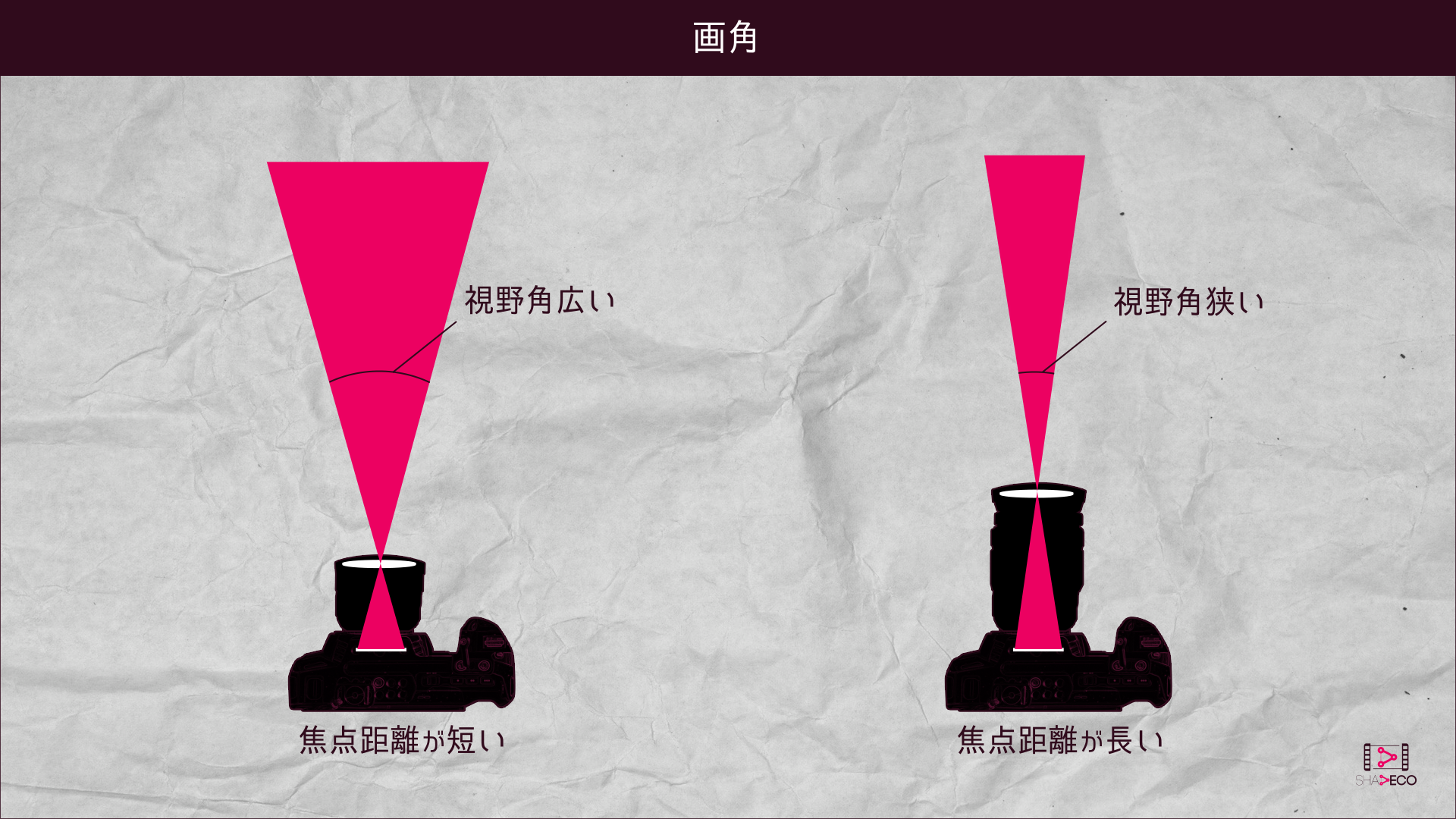

紙を丸めて覗き込んだ状態を想像してみよう。レンズが長くのぞき穴に相当する最前面のレンズが遠くにあれば、見える範囲は狭まる。焦点距離によって視界の角度が決まるということである。これを「画角」と云う。

画角

レンズから見える範囲を角度で表したものを「画角」と云い、記述する場合はセンサー長方形の対角線の角度を基準とするのが一般的。なんで対角線?わかりづらいね。縦と横で書いて欲しいものだ。

縦と横のサイズの比率を「アスペクト比」と云う。

アスペクト比

いくつかフォーマットがある。「縦横比」と云われるが、「横:縦」で表されることが多い。ややこしいね。

エジソンが発明したフィルムが理由不明だが4:3だったそうだ。その後、フィルムに音を同時に記録するようになった際に、フィルム上に音トラックの記録スペースを設けたことで横が少し短くなるなどフィルム面積と画角としてのバランスもろもろが模索され、映画芸術科学アカデミーが4.135:3に標準規格として定めた「アカデミー比」となるタイミングがあった。

テレビが発明され、ブラウン管時代のテレビは4:3の「スタンダード」へ。

余談:DVD納品に必要な知識

未だに残るDVD納品の際にブラウン管の知識が必要となるため一応記載する。ブラウン管テレビは走査線=フィールドと云う横に細いビームを上から下に照射し1フレームを投影する。ローリングシャッターをイメージするとわかりやすい。このビームを1フレームあたり奇数の捜査線→偶数の捜査線と2回上下に光らせると、人間の目では残像によって動きを滑らかに見せた上で時間あたりのデータ量を半分にできるため、安定したデータ転送が必要なテレビ放送で都合がいい。このように描画回数を増やし伝送レートを節約できる方式を「インターレース方式」と云う。走査線を飛び越すため「飛び越し走査方式」とも云う。日本を含めこのインターレース方式を採用した放送をNTSC方式と云う。インターレースに対し走査線を飛ばし飛ばしにしない方式を「プログレッシブ方式」と云い、1秒あたりのコマ数を減らして実現する。プログレッシブ方式を採用した国の放送をPAL方式と云う。

わかる。専門用語が次々出てきて苦しい。だが現在の液晶モニタと編集ソフトでブラウン管時代の仕様であるDVD用のシーケンスを作成する際の設定に必要な知識である。今少し堪えて欲しい。

DVD用の映像サイズは2パターン。編集ソフト上のシーケンス設定では4:3の映像なら640×480ピクセル、16:9の映像にしたい場合は854×480ピクセル(ソフトによって853×480ピクセル)で作る。Blu-rayなら地デジと同じ1920×1080ピクセルで作る。この映像ファイルをDVDプレーヤー、Blu-rayプレーヤーで再生できる形式に変換する「オーサリング」用のソフトを使い、メニュー画面をデザインするなどして、DVDやBlu-rayに書き込みができる機械「DVDドライブ」で焼く(CDやDVD、Blu-rayディスクに専用ドライブでデータを書き込むことを「焼く」と云う)。DVD-RやBD-Rにmp4などをただ焼くと、DVDプレーヤーでの再生とならず、PCで読み取り可能な外付けメディアとして機能し、DVD再生専用機材では再生できない場合がある。「DVD-Video形式で納品せよ」となった場合、オーサリングソフトでの変換が必要。前時代の仕様として、対応ソフトが最新OSでは動かないものも増えた。Adobeにおいては「Encore」というオーサリングソフトがかつてあったが、開発が終了し公式サイトでのインストーラー配布も終了しているようだ。オーサリングの学習コストなどを考えると、オーサリングしてくれる業者に外注も検討。上映会場がPCでの動画ファイル上映に対応していれば一番簡単である。

さらに、1ピクセルの縦横比を「ピクセル縦横比」「ピクセルアスペクト比」と云い、DVD-Video(走査線用テレビ放送のデータも)はこれが正方形ではない。パニック。わずかに縦長となる10:11になる。そしてNTSCの16:9(ワイドスクリーン)では40:33と横に引き伸ばすことで横長の画角を実現する。パニック。プレーヤー側でこれを補正する機能があれば問題ないが、この機能がなければ、映像がほんの少し縦長に表示され左右にスペースが出来てしまう。オーサリングソフトで補正された設定で焼く必要がある。この補正がどうもソフトによってまちまちな挙動をするため、1回目の書き込みは失敗するものとして書き込んで確認して正解パターンを探ることになると思われる。

アスペクト比続き

話を戻すと、自宅で手軽に映像が見れるようになり減ってしまった映画館の客足を取り戻すために、特大スクリーンで上映するようになったことで映画は2.88:1の「シネラマ」(3台のカメラでパノラマ撮影し、3台の映写機で上映)の超横長時代へ突入する。

これにテレビが対抗し、低コストでワイドスクリーン映像を届けたいと、上下に黒帯を入れ少し小さくトリミングしてでも4:3のテレビで映画の迫力を輸入できないか試行錯誤する。あまり感触は良くなかった。

像を1方向に押しつぶす特殊なレンズが発明される。「アナモルフィックレンズ」と云う。後述する。1台のカメラで2:1の横長映像をセンサーに届けられる。35mmフィルムで音のトラックの記録スペースを確保するなどいい塩梅を探し2.35:1の「シネマスコープ」へ。

同時期にパラマウント(現パラマウント・ピクチャーズ)が35mmフィルムで映像面積を広げノイズ(フィルム粒子)を減らす独自規格を開発。記録面をフィルム方向に90°回すことで、めちゃくちゃでっかく撮れる、1.85:1の「ビスタサイズ(ビスタビジョン)」が生まれ、シネマスコープとどちらも普及したため、混在が続く。

シネラマを1台のカメラ、1台の映写機で実現するため、フィルムそのものをでっかくしちゃえと力技で70mmフィルムが開発される。これもまた高精細+迫力を前面に押し出したアスペクト比が模索され、現在は映画用に「IMAX」として1.43:1~1.9:1に落ち着いた。映画館至上主義のクリストファー・ノーラン監督が好んで採用する。1.43:1の縦にも広いアスペクト比の映像は、シネマスコープ方式の映画館では上下を切るか縮小して上映する。IMAXシアターがこれを味わい尽くせる唯一の映画館であるため、騒がれているわけだ。ただしこれは「IMAXフィルムシアター」で全面積を上映できるが、日本国内のほとんどのIMAXシアターは、1.9:1。上下をカットしている。

調べると、国内では109シネマズ大阪エキスポシティとグランドシネマサンシャイン池袋のみが、IMAX本来のアスペクト比で上映できる超巨大スクリーンを備えている。映画史はこれが現在まで。

こうして映画史とテレビ史が並行して異なる発展を遂げてきた。テレビ史に話を戻すと、映画をそのまま輸入は無理だ。コストを抑えて普及させなくてはならない。そこで映画の2.35:1とテレビの4:3の中間で妥協しましょうという中で16:9が登場する。

4:3の映像も、2.35:1の映像も、上下か左右に黒帯を足して投影することで、大体同じ面積で見れるよねということだ。これが現在、あらゆるデバイスが16:9のスクリーンを備えている理由だ。

YouTubeや現在のテレビは地上デジタル放送からテレビで採用されている16:9の「フルHD」。インスタグラムなどで採用されている1:1。スマホ縦型動画の9:16とバリエーションがあるため、納品のための仕様を必ずクライアントに確認する。

このように、撮影時のフォーマットと編集フォーマット、納品フォーマットが異なる場合、トリミングが発生するため、正しい知識を持って撮影開始時には確定しておくのが望ましい。

アスペクト比一覧

アスペクト比と編集時に設定するサイズのピクセル数例をまとめる。ネット上で信頼に足ると判断したサイズの言及がある場合はそれを、これ以外は、現在はフルHDの1920×1080pxのモニタで視聴することが”一般的”であり、これの縦か横をフル活用できるピクセル数が都合が良いと判断し、記載する。4Kの場合は数値をそのまま倍に。フルHDは大体で「2K」、3840×2160も大体で「4K」と呼ぶ。どちらも2K、4Kないのに。

| アスペクト比名(アスペクト比) | 解像度例 |

|---|---|

| ブラウン管(4:3) | 640×480px |

| 近年一般的なモニタ、地デジ(16:9) | 854×480px, 1920×1080px |

| シネラマ(2.88:1) | 1920×667px, 3110×1080px |

| シネマスコープ(2.35:1~2.4:1) | 2.35例) 1920×817px, 2592×1080px 2.40例) 1920×800px, 2592×1080px |

| ビスタサイズ(1.85:1) | 1998×1080px, 1920×1038px |

| IMAX(1.43:1~1.9:1) | 1.43例) 1544×1080px, 1920px×1343px 1.90例) 2052×1080px, 1920px×1011px |

| SNSなど正方形(1:1) | 1080×1080px |

| SNSなど縦動画(9:16) | 1080×1920px |

画角:続き

画角が広い、狭いと云う。ただし、注意点として一般的にレンズには角度でなく焦点距離の「mm」が表記される。これと撮影モードのセンサーのサイズ、縦横の比率から実際に映る範囲を計算する。もうちょっとなんとかならんのか。

人間の目に近い約46°の範囲が映る50mm近辺が標準レンズと呼ばれ、約63°以上の広い範囲が映る35mm以下のレンズを広角レンズ、約30°以下の狭い範囲が映る80mm以上のレンズを望遠レンズと呼ぶ。50mmレンズは標準レンズと呼ぶ認識は広く定着しているが、境目は曖昧で、35mmレンズを標準レンズと呼ぶ人もいれば、広角レンズと呼ぶ人もいる。

気力があれば、よく使うレンズが持っているカメラでそれぞれ画角が何°か早見表を作っておくという手もあるが、こうなるとレンズを交換して実際にカメラ上で見たほうが早いケースも多分にあり、もうちょっとなんとかならんのか。

撮影シミュレーション(ロケハン)など、いちいち様々な角度から実際のカメラでレンズを交換して視野を確認していては大変なので、確認用の機材もある。「ディレクターズビューファインダー」と云う。

ディレクターズビューファインダー

望遠鏡のような形で、大体は首から下げられるようにストラップが付けられる。アスペクト比と焦点距離を選択できる機構があり、その設定で覗けば視野を確認できる。ファインダーなので一度に1人が確認できる。ボディとレンズの組み合わせによってビューファインダーとは微妙にズレるはずなので、大まかな使用レンズのシミュレーションが手軽にできる。

有名どころはAlan Gordon「Mark Vb Director’s Viewfinder」。10~15万円くらい。使ってみたい。

これのミニ版「Pocket Mini Director’s Viewfinder」は3~4万円くらい。使ってみている。限られた時間でのロケハンで画角選定には上手く機能するように感じている。ただ手持ちの機材での映りにピッタリ合致する設定ができない点はあり、違いを事前にテストしておくことで解消している。

カメラ内臓機能のディレクターズビューファインダー

カメラの液晶モニタ上でこの機能をシミュレーションできるカメラ機種もある。SIGMAの「fp」シリーズ(他にもあるのか不明)。レンズの視野をシミュレーションする機材のシミュレーションである。選択肢がシネマカメラのみ。

レンズビューファインダー

実際のレンズを取り付けられるファインダー。そのため実際の視野を完璧に把握できる。デジタルシネマカメラやシネマフィルムカメラなど重いボディを持ち歩かなくていいという利点は残るが、レンズを持ち歩かなくてはならないため、軽量なカメラを使用している場合はほぼメリットはない。

ビューファインダーアプリ

スマホアプリもある。「Magic Cinema ViewFinder(無料)」や、「Cadrage Director’s Viewfinder(3,000円)」など。カメラ機種、モード別センサーサイズ、レンズを選択して、フレームガイドで視野をシミュレーションできる。スマホの視野角以上の広角レンズはもちろんシミュレーションできない。

Cadrage Director’s Viewfinderの方は使用経験があり、位置情報やある程度精度高く撮影の方角、レンズ画角のメタデータ埋め込みといったアプリならではの利便性がある。

もちろん、カメラマンが軽量装備でロケハンをするのに役立つのは言わずもがな、特に構図の決定権を持つ人とカメラマンが別であれば、あると便利。

画角のシミュレーション

普段使う1軍のレンズであれば、大体どこまで映るか覚えていくはずだ。問題はレンズ本数が増えてきた場合やレンタル、ズームレンズを使用する場合だ。

一応の個人的な解決策としては、体の一部を定規として設定することだ。筆者の場合は右手を肘を伸ばし、中指を9時方向、親指を12時方向として手のひらを顔に向けてかざした際、手首から中指の先端まで35mm、親指の内側から中指の先端までが50mm、親指と人差指の間のシワから人差し指の先端までが100mm、親指の内側から人差し指の第二関節まで200mm、そしてそれぞれ両手でmm数を半分にできる。

焦点距離と画角

焦点距離によって決まる画角。正直、あまり対角線でイメージしないはずだ。多くの場合、重視するのは横がどこまでの範囲映るかだと思われる。一番右の列だ。角度でイメージできるよう、一覧表を記載する。何度も言うがカメラとレンズの組み合わせによって微妙に変わるため、あくまで目安だ。自身の一軍レンズは実際にファインダーを見て覚えておくに越したことはない。

参照元:https://keisan.casio.jp/exec/system/1378259716

| 焦点距離(フルフレームにおいて) | 画角(視野角) | 画角(縦) | 画角(横) |

|---|---|---|---|

| 10mm | 130.4° | 100.4° | 122° |

| 12mm | 122° | 90° | 113° |

| 14mm | 114° | 81° | 104.3° |

| 16mm | 107° | 73.7° | 96.7° |

| 18mm | 100.5° | 67.4° | 90° |

| 20mm | 94.5° | 62° | 84° |

| 24mm | 84.1° | 53.1° | 73.7° |

| 35mm | 63.5° | 37.8° | 54.4° |

| 50mm | 46.8° | 27° | 39.6° |

| 75mm | 32.2° | 18.2° | 27° |

| 100mm | 24.4° | 13.7° | 20.4° |

| 135mm | 18.2° | 10.2° | 15.2° |

| 150mm | 16.4° | 9.1° | 13.7° |

| 180mm | 13.7° | 7.6° | 11.4° |

| 200mm | 12.3° | 6.9° | 10.3° |

| 300mm | 8.25° | 4.58° | 6.87° |

広角と望遠

レンズの焦点距離はズームレンズにおいて「倍率」と表すこともあり、焦点距離を長くするということは拡大しているに過ぎない。

焦点距離が異なったとしても、カメラと被写体の位置が同じであれば、映る範囲が違うだけであり、これは単純に像を拡大・縮小しているに過ぎない。”画質が粗くなることを考慮しなければ”、広角レンズで撮影した画を編集ソフト上で拡大すれば望遠レンズで撮影した画と同じ見た目になる。狭い範囲をトリミングしていることと同じだ。

これを画質を損なわずに拡大したいがために、光学的に拡大する望遠レンズを使い分けるわけだ。

広角レンズ以上に、像を歪ませてでも極端に広い範囲を映せる、超広角レンズとも言える「魚眼レンズ」もある。

魚眼レンズ

「フィッシュアイレンズ」とも云う。特段、魚の目の仕組みを応用したものではなく、水中から水上を見上げると景色が円形に歪むことから名付けられている。通常のレンズは平面で切り取った像を平面のセンサーに射影することを目指すが、魚眼レンズはより広い視野角を得るために、眼球のような球体が捉える像を切り取り平面のセンサーに射影することを目指す。そのため非常に大きな樽型の収差が起こる=中央ほど大きく映り、端に近いほど圧縮される。

通常のレンズで採用されている中心射影方式は114°程が限界とされ、これを超えるとセンサーの範囲に収まらなくなるため広角レンズという製品の画角に上限がある(たしか)。

あくまで射影方式が違うということであり、等距離射影方式のレンズは全て魚眼レンズと呼べるが、望遠レンズで激しい歪みは需要がないため、一般的に180°近い視野を得られる超広角レンズが魚眼レンズと認識されている。

広角と望遠の見え方の違い

ここで異なる焦点距離で被写体が同じサイズになるよう撮影した場合の見え方の違いに注目したい。

広角レンズでは被写体の近く、焦点距離を長くするほど被写体から離れて撮影している。

被写体の見え方に注目すれば、近ければ凹凸が強調され、特に台が歪んでいるのが分かる。人物であれば鼻が大きく、耳が小さくなる。遠ければ凹凸が潰れ、平面的に見える。

被写体から離れるほど、被写体と背景の映る範囲の差が小さくなり、背景が近くに見えることだろう。前後の空間が圧縮されて見えることから、「圧縮効果」と云う。

圧縮効果(撮影距離による)

カメラと被写体の距離が離れるほど効果が強くなる。あくまで被写体とレンズの距離によって起こる。1m先と2m先の違いは大きいが、100m先と101m先はカメラからは差はなくなる。

遠近感を圧縮できることで、次のような現象が起こる。

- 前後に距離差のある被写体同士もほぼ同じサイズに映すことができる

- 背景が大きく映る

- 前後に動いても移動を感じない

これらにより、悪役から逃げる人物が、いくら走っても距離を離せない、目的地へ近づいていないような表現に活用できる。

逆に被写体とレンズが近いほど遠近感が強調され、空間が膨張する効果があるがこちらには名前が付いていないようだ。筆者が知らないだけかもしれない。

広角レンズで被写体に近づけば、次のような現象が起こる。

- 前後に距離差のある被写体同士のサイズ差が大きくなる

- 背景が小さく映る

- 前後の動きが非常にダイナミックに感じられる

これらにより、カメラに向かってのパンチが、近づくほど加速し、実際よりも破壊力が高く感じるような表現に活用できる。

時間の圧縮

スクリーンショットを例に空間が圧縮されることを述べたが、動画ではさらに圧縮される点がある。時間である。

同じアクションをより広角レンズで撮影するに従い、情報量が増えることで同じアクションであってもテンポが速く感じるだろう。望遠になるに従い、背景が除外され主題以外の情報が少なくなり、観客がそのカットの情報を受け取り終わる時間が短く済む。よって、カットの切り替えデュレーションは、望遠ショットは短く、広角ショットは長くなるのが自然である。

ちなみに、緊張感のある会話シーンは望遠で機能しやすくなるが、こちらはショットサイズの回で後述しようと思う。

当然絶対ではなく、制作者の意図による。

レンズのmm数はフルフレームイメージセンサー目線

このmm数での表記は、レンズからセンサーまでの焦点距離を表す。しかしながら、センサーサイズがいくつもあることを紹介したが、復習するとセンサーサイズが変われば、映る範囲は変わってしまう。センサーが小さいほど、映る範囲が小さくなる。レンズの取り込む範囲よりもセンサーが小さければ、クロップされる(捨てられる)面積があるわけだ。具体的にはフルフレームカメラ用の100mmレンズをAPS-Cボディに接続した場合、フルフレームカメラで150mmのレンズを使った場合とほぼ同じ画角で撮影できる。

異なるセンサーサイズ間のレンズmm数の「換算」

フルフレーム用のレンズをAPS-C機で使う場合は1.5を掛けた150mm相当となる(キヤノンのレンズなら1.6倍)。これを“「35mm換算」や「フルサイズ換算」、「フルフレーム換算」で150mmのレンズ”という。

始めはややこしいが仕組みが分かれば便利だ。根気強く理解して欲しい。

同じレンズをm4/3機で使うと2倍の200mmレンズ相当として使うこととなる。フルフレーム用100mmレンズはm4/3機では“「フルフレーム換算」で200mmのレンズ”という。

ちなみに、APS-C(キヤノン以外)のレンズをm4/3機で使う場合は、4/3倍してやればいい。わかりやすい。APS-C(キヤノン以外)100mmレンズ+m4/3センサー=134mm相当、同じく50mmレンズ=67mm相当、24mmレンズ=32mm相当だ。

主なセンサーサイズと焦点距離のフルフレーム換算をまとめる。

| センサーサイズ | フルフレーム機の画角に換算するための倍率 |

|---|---|

| フルフレーム | 1倍 |

| APS-C(キヤノン以外) | 1.5倍 |

| APS-C(キヤノン) | 1.6倍 |

| m4/3 | 2倍 |

レンズ交換をする際に、焦点距離から映る範囲を想像するために1.どのセンサーサイズ用のレンズなのか、2.ボディのセンサーサイズ、これを組み合わせた際の映る範囲を計算しやすくするための知識である。

大センサー用レンズと小センサーボディの組み合わせ時のメリット

「レンズの取り込む範囲よりもセンサーが小さければ、クロップされる(捨てられる)面積がある」ということは、「光学的に拡大している」のと同義である。より望遠で撮影したいのであれば、有効な手段となり得る。

200mmのフルフレーム用望遠レンズをm4/3機で使えば、フルフレーム機で400mmのレンズを使った場合に相当する画を得られるのだ。

センサーサイズが大きいほど広角に強く、小さいほど望遠に強いとなる。後述するボケはセンサーサイズが大きいほど大きくしやすいため、ボケと望遠、どちらを優先させるかによって適切なセンサーサイズ選びは変わる。

センサーサイズごとの専用レンズ

センサーサイズに合わせて開発されたレンズもある。

APS-C専用のレンズは、APS-Cセンサーを覆うサイズの光しか通さない。この組み合わせで起こる問題を認識しておこう。

小センサー用レンズと大センサーボディの組み合わせ時の注意

マウントさえできるのであれば、フルフレーム用レンズを小さなセンサーサイズ搭載のボディで使う分には問題ないが、逆に小さなセンサーサイズ用に開発されたレンズをフルフレーム機で使う場合、センサーサイズよりもレンズを通す光のサイズが小さいなら当然像が欠ける。

センサーサイズ以下のレンズの使用やレンズフードやレンズ用フィルターなどのアクセサリーによる、「レンズ設計上、想定外の要因が原因となる物理的な影」については、「ケラレ」と云う。極端にレンズに近い照明をレンズフードが遮るなど、部分的な光量低下もケラレと呼んだり呼ばなかったり。ケラレがある、ケラレを起こしている、ケラレている、と使う。

手持ちのレンズとボディが正常に組み合わせられるか確認して使おう。ケラレた部分が見えないほど編集時に拡大して使うこともできなくはないが、当然粗くなる。

アナモルフィックレンズ:序章

アスペクト比の項でも話の出た、像を1方向に押しつぶす特殊なレンズ。映画の価値を高めるため、そして迫力のある横長の像を得るために開発された。横方向に広角に撮影できる。センサーが横長にはならないため、横を圧縮した縦長の像をセンサーで記録し、編集で横方向に引き伸ばす。何倍圧縮するかの倍率はレンズによる。特殊なレンズである以上、とにかく高価。圧縮率を落としたり、近年は技術革新によって価格を抑えた製品もちらほら出てきている。いいぞ。

説明にフォーカスの事前知識が必要なため、後に改めて別項を設け後述する。

手ブレ補正機構

ハンドヘルド(手持ち撮影)では人間がカメラを支える以上、揺れは起こる。シャッタースピードが早く、「モーションブラーがない(像のブレが生じてはいない)」場合も映像が細かく振動していれば広義の「手ブレ」と表現する。体を静止させ硬直状態に保つ場合、足の裏で細かく重心のズレを戻し続けるため、足を横に揃えた場合は前後、足を前後に揃えた場合は左右の揺れが補正しきれず大きくなる。カメラ購入後2年ほど、撮影を学ぶ中で気付いたことがある。1.生き物はマイクロバイブレーションが常に生じており、基本的に止めることはできないこと。そして2.シャッターは一瞬とはいえ1/10秒でも動いた全ての光を足し算で記録し、マイクロバイブレーションの方がはるかに速く動くこと。また、3.筋肉に適度な負荷がかかった状態では揺れが抑制される場合があることだ。

次第に重い機材へ持ち替えていく場合をイメージすると、軽すぎる機材は手の本来の振動がカメラにダイレクトに伝わるが、筋肉量に応じた荷重は文鎮の役割を果たし、マイクロバイブレーションを押さえつけることで振動が抑制される。ただ重すぎる機材は筋肉が強力な収縮を必要とし、これもブルブルと震え始める。機材に合わせた筋力のバランスを年単位で保つことは難しく、余裕のある筋力を以て軽量な機材にカウンターウェイトを検討するのが現実的だろう。

ただし現代では、手の振動をセンサーに届く前に抑制する仕組みがある。細かな揺れについてはレンズ内での補正機構とボディ内での補正機構がある。関節を軸にした回転運動は後述するジンバルがある。高荷重による震えは後述する荷重を分散するベストがある。

回転に注目し、まずはどんな揺れが起こっているのか?体の構造に着目してみよう。

手ブレの成分

前提として細かな振動こそが生き物に必ず起こるマイクロバイブレーションだと認識する。これがある場合、カメラマンはまだ生きている証拠だ。安心して良い。

人間の体は、関節で繋がった伸縮しない骨組みであることから、姿勢の変化は筋収縮による関節を軸とした回転運動となる。しかしながら、軸との距離が長いほど、先端が描くカーブはなだらかになり、カメラからすると「移動」と見做せる。このことから、腕、手首、指とカメラに近い関節を軸とする揺れは回転揺れ、重心移動による足を軸とする揺れは移動揺れに相当する。

カメラを手で持つということは、足をうまく固定できたとしても、手の揺れは防げないだろう。カメラに近い関節軸の揺れ。大きな手ブレの成分の殆どは回転揺れである。脇を締めることで肩+肘の回転を抑えることができる。指を締めることで手首から先の回転を抑えることができる。手首が固定できないのだ。また、両手でカメラを保持することで左右の手の力の入れ具合を完全に同じにできないことから、軽量な場合は片手のほうが回転しない。むしろ左手で右手首を握ったほうがいいまである。

ただしいずれの場合も、力を入れすぎると筋肉の強力な収縮による震えが始まるため、例えば関節用のサポーターが有効な可能性がある。これはドラッグストアで取り扱っているが、筆者は撮影機材と認識している。

3次元空間において、回転は3方向に分解できる。

| 1.ピッチ | Yesの動き、ドローン前後移動の傾き、縦回転 |

| 2.ヨー | Noの動き、ドローン回転の動き、横回転 |

| 3.ロール | Questionの動き、ドローン左右移動の動き |

そして回転運動のほうが映像としてのブレの度合いが大きい。なぜなら、カメラの角度を一切変えずに5mm移動する画と、手が5mm移動する回転をした画を比較すると、明らかに回転したほうが映る範囲への影響が大きいはずだ。

望遠レンズを使えば、例えば200mmレンズならセンサーで映せる範囲は縦6.9°、横10.3°だ。7°縦に回転しただけで1画面分はズレてしまう。広角レンズを使えば、例えば20mmレンズなら映る範囲は縦100.4°、横122°。縦に90°回転してようやく1画面分のズレだ。

対して移動(と見做せる)揺れは、対象が遠いほどカメラの動きはわからなくなる。被写体との距離が重要だ。100m先を映している場合、上下左右に1mも動いたところでほぼ動いたことはわからないだろう。映る範囲が「遠い」場合、相対的に1cm程度のカメラ移動は映像に反映されにくいということだ。ただし、手前に物体がある場合は大きく動く。遠くの山を狙ったところで、目の高さでカメラを構えることを「アイレベル」と云うが、これなら電線や木などが手前に入り込みやすく、これらがカメラの揺れを認識する助けになってしまう。

これに着目し、かつては重り(カウンターウェイト)を吊り下げたハンドル「スタビライザー」がカメラ用に展開されていた。重心を下げやじろべえの原理で素早い揺れを抑制していたのだ。今ではモーターでピッチ、ヨー、ロールの3軸を回転した分戻す「ジンバル」が主流だ。後述する。

電子式手ブレ補正と光学式手ブレ補正

電子式手ブレ補正は編集ソフト上での手ブレ補正エフェクトと同じく、1フレームごとに映像を解析して揺れと逆に画を移動することで補正する。

つまり、映像の端がズレることで上下左右のいずれかがかならず欠ける。この欠けが見えないよう拡大してトリミングして使うということであるため、画角が狭くなると共に粗くなる。

あくまでただの上下左右への移動を補正するだけであり、モーションブラーはそのまま残る。

光学式手ブレ補正は3つの方式がある。

レンズ内手ブレ補正

レンズにジャイロセンサーが入っていて、補正専用のレンズユニットが光の屈折を利用して手ブレを補正する。上下左右の移動、回転は打ち消すが、ロール回転に対応しない(はず)。

望遠レンズほど効果的。

ボディ内手ブレ補正

デジタルカメラになり、フィルムでは不可能だったセンサー自体をブレと逆にシフトして手ブレを打ち消す。

装着するレンズに関わらず補正できる。手ブレ補正機構のない小型軽量なレンズを組み合わせることができる。

近年の機種では、レンズ内手ブレ補正の機能に加え、ロール回転ブレにも対応する。

望遠レンズほど効果を感じやすい。

シンクロ手ブレ補正

レンズ内手ブレ補正と、ボディ内手ブレ補正を組み合わせたハイブリッド手ブレ補正機能。一番効果が強い”ようだ”(使ったことない)。

レンズ内、ボディ内、両方の手ブレ補正機能が息を合わせる必要があるため、レンズとボディがシンクロ手ブレ補正に対応している組み合わせでないといけない。

単焦点レンズとズームレンズ

画角が固定で変更できない「単焦点レンズ」、画角が可変の「ズームレンズ」がある。単焦点レンズは「50mm」など単一のmm数表記、ズームレンズは「24-70mm」など焦点距離の可動範囲の両端のmm数表記。

レンズはこんな感じになっている。ピントを調整したり、焦点距離を変えるためには内部でレンズが前後に動くわけだ。どう動いても最終的にセンサーの位置で結像しなくてはならないため、いろんなレンズを組み合わせて設計されている。エグい。使用者は設計に関して特に考えなくてもいいが、レンズ枚数が多いほど当然重くなる。

パンケーキレンズ

全長が短い、薄いレンズのこと。軽く、かさばらない。形状の呼称であり、mm数は関係ないが、全長が短いということは焦点距離が短いということであり、望遠レンズのパンケーキレンズは通常ない。

レンズのマウント

メーカー、機種によってレンズとボディの接続部の規格がいくつかに分かれる。異なるマウント同士は形状やサイズが違うため連結できない。組み合わせによっては変換アダプタがある。

Canon

| EFマウント | フルフレーム用/APS-C用 |

| EF-Sマウント | APS-C用(一眼レフ) |

| EF-Mマウント | APS-C用(ミラーレス) |

| RFマウント | フルフレーム/APS-C用 |

Nikon

| Fマウント | フルフレーム用/APS-C用(一眼レフ) |

| Zマウント | フルフレーム用/APS-C用(ミラーレス) |

OLYMPUS

| m4/3マウント | m4/3専用 |

| OMマウント | フルフレーム用/APS-C用(ミラーレス) |

SONY

| Aマウント | フルフレーム用/APS-C用(一眼レフ) |

| Eマウント | フルフレーム用/APS-C用(ミラーレス) |

FUJIFILM

| Xマウント | APS-C用(ミラーレス) |

| Gマウント | GFXシリーズ(中判)専用 |

Panasonic

| Lマウント | フルフレーム用/APS-C用(ミラーレス) |

| m4/3 | m4/3専用 |

Leica

| Mマウント | ライカのフィルムカメラ専用 |

| Lマウント | フルフレーム用/APS-C用(ミラーレス) |

ARRI

| PLマウント | フルフレーム用/スーパー35mm |

マクロレンズ

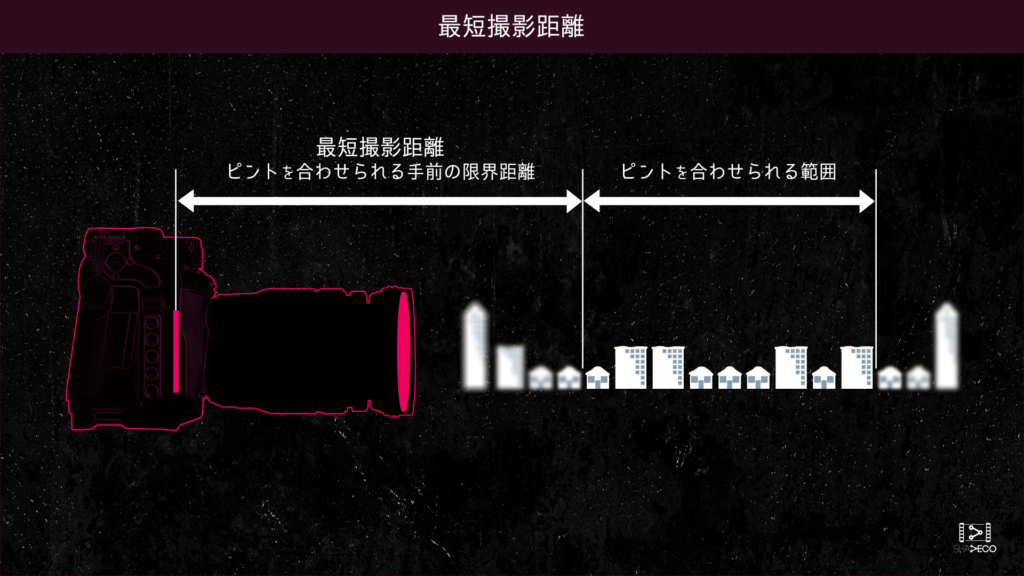

センサーからピントを合わせられる一番手前の限界距離までを「最短撮影距離」と云う。これ以上近づくとピントを合わせることができない。レンズ前面でなく被写体とセンサー間の距離。レンズに0.2mなどと記載されている場合がある。

ボディ内部でセンサーがどこにあるのか、ボディの上部に目安としてΦマーク(フィルム面マーク)があるカメラもある。

最短撮影距離を極端に短く設計した、寄れるレンズがあり、「マクロレンズ」と云う。花や虫、指紋、目の光彩など、肉眼で見えないディテールを撮影できる。筆者の眼球に寄ってみよう。

近づきにくい野生動物や鳥を大きく撮る目的で「望遠マクロ」もある。マクロレンズを使用する際に意識したいのは「どれくらい寄れるか」ではなく、「ワーキングディスタンス」。

ワーキングディスタンス

最短撮影距離の内、レンズ前面からセンサーまでの距離を引いた、「ピントが合った被写体からレンズ前面まで」の距離。

忘れがちだがレンズはボディに比べ大きく前面に飛び出ているため、カメラを構えて液晶モニタを注視していると、極端に近づく際に被写体にぶつかる、コントのようなことが起こる。

撮影者、マウント部、レンズへのダメージはもちろん、被写体への影響はときに大きな問題となる。ある程度の重量を持った硬い物体を扱っている意識を忘れず、細心の注意を払うこと。

そこそんなに長文必要?と思うかも知れないが、いい画のために魂を注いでいる、まさにその瞬間は安全性が意識の外に追いやられることがある。対象物と近距離での機材位置調整はゆっくり、トルクをあまりかけずに行う。

カメラコントロール3つ目の絞りへ

カメラで設定できる要素の3つ目、絞りを理解するための事前知識がそこそこ入ったところで、カメラコントロール終盤戦へ突入しよう。

↓次

この記事へのコメントはありません。